こんにちは。Web3に興味があって、AIをもっと使いこなしたい中高年を応援するWeb3とAIマニアじいじのko_sanです。

2025年の2月6日にリリースされた、Genspark MoA v2(Mixture-of-Agents)について、今までのものとの違いと何が嬉しいのか教えて。

そんな疑問にお答えします。この記事では検索用に便利なGensparkがさらにどう進化して便利になったかを実際使ってみたので、詳しく解説します。

◾️Gemini 2.0搭載の新しいAIモデルGenspark MoA v2(Mixture-of-Agents)とは?

1)Gensparkとは

GensparkはPerplexityと並んで、AIが自動的に複数のウェブサイトを巡回して、必要な情報を整理・統合し、一つのページとして提供する新しいAI検索エンジンです。参照URLを表示してくれるのがありがたいところです。

Gensparkについてはこちらの記事を参照ください。

2)Gemini 2.0搭載の新しいAIモデルGenspark MoA v2(Mixture-of-Agents)とは?

2025年2月6日にリリースされたGenspark MoA v2(Mixture-of-Agents)は、検索に便利なだけでなく、Gemini 2.0と連携しており、特にマルチモーダル機能や生成速度の向上が期待されています。

この新しいバージョンは、ユーザーのニーズに応じた情報提供をより効率的に行えるようになりました。

その使い方の例を詳しく見ていきます。

◾️Genspark MoA v2がGemini 2.0との連携することのメリット

主に以下のようなメリットがあります。

高度なマルチモーダル処理

Gemini 2.0は、テキスト、画像、音声などの異なる形式のデータを同時に処理する能力を持っています。これにより、MoA v2はユーザーが求める情報をより直感的に提供できるようになります。

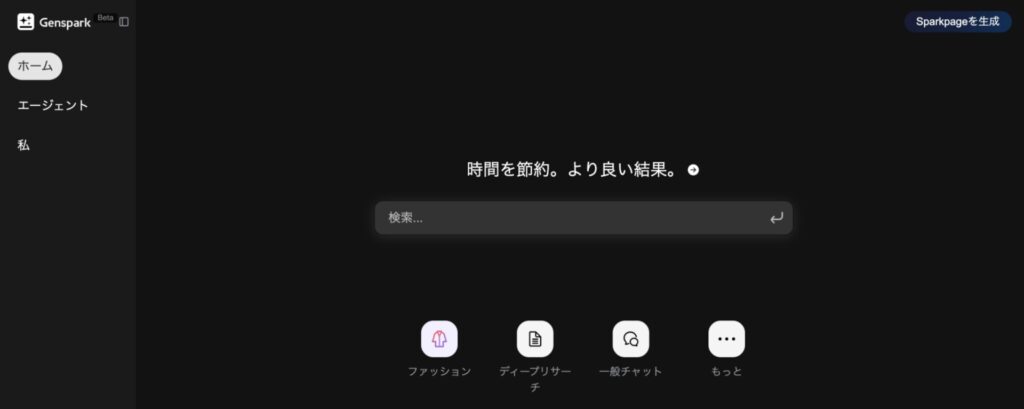

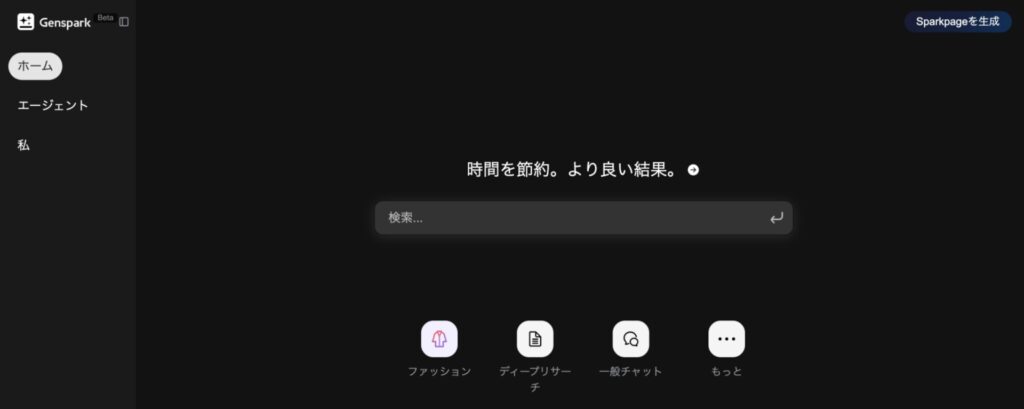

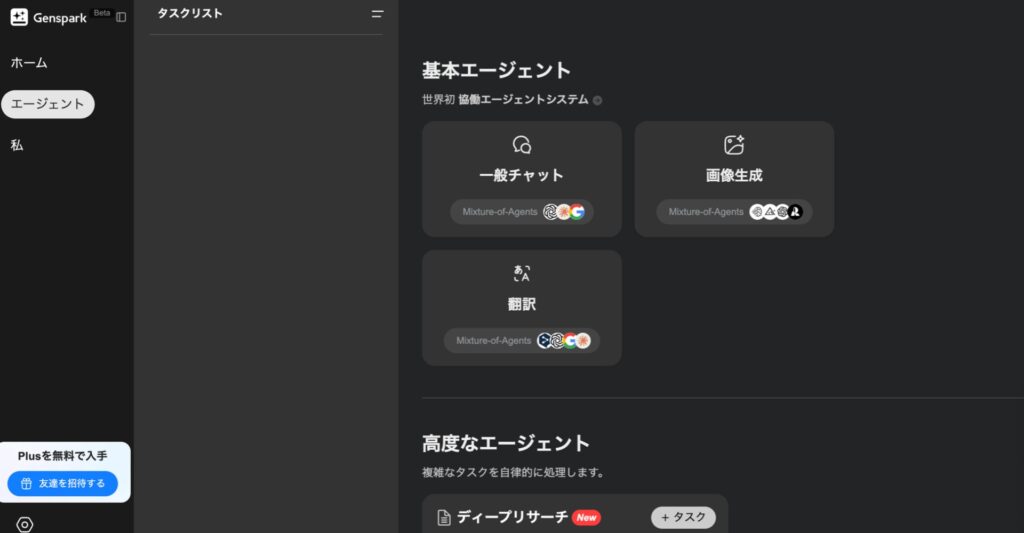

ホーム画面はこちら。

エージェント機能の強化

Gemini 2.0は「エージェント的」な機能を持ち、ユーザーのニーズを予測し、複数のステップを計画して実行することが可能です。これにより、MoA v2はより効率的にタスクを処理し、ユーザーの作業をサポートします。

こちらがホーム画面から「エージェント」を選んだときの画面です。

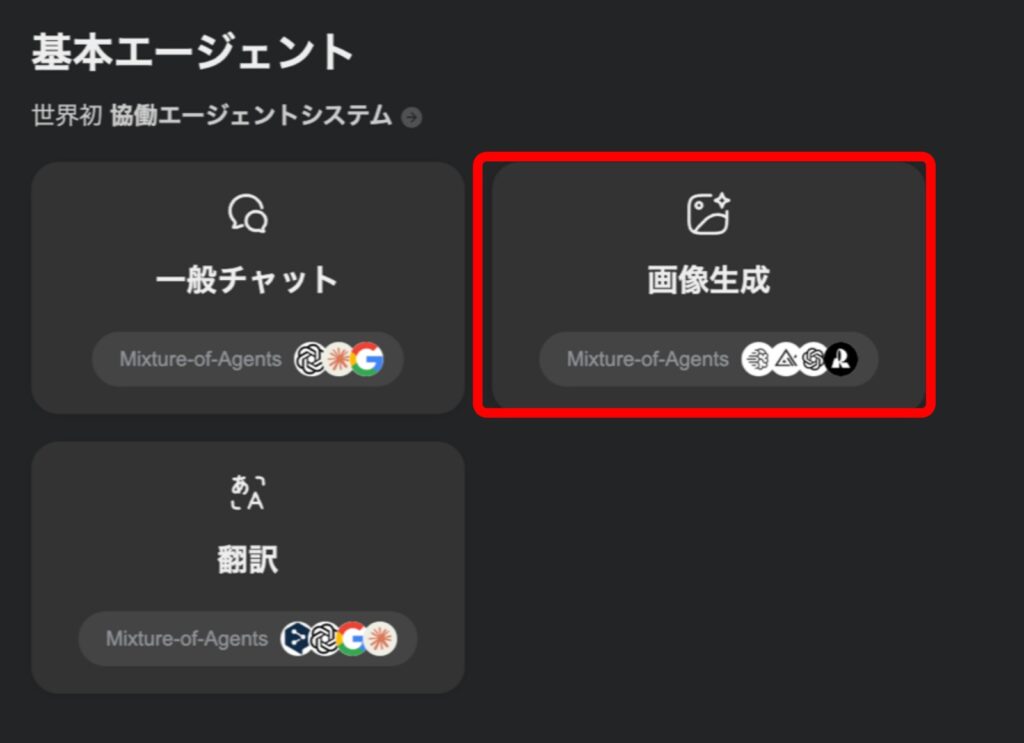

今までの検索主体から、ChatGPTの様に基本チャットが加わり、その他に画像生成、翻訳に特化したエージェントが利用できるようになっています。

迅速な応答性

Gemini 2.0は、処理速度が向上しており、MoA v2との連携により、ユーザーは迅速にフィードバックされた答えを受け取ることができます。業務の効率が大幅に向上しそうです。

自動化と効率化

Gemini 2.0の機能を活用することで、MoA v2は業務の自動化を促進し、ユーザーがより戦略的な業務に集中できるようになります。例えば、データ分析やレポート作成の自動化が可能です。

ここについては別途活用してみようと思いますが、今回は基本エージェントの画像生成と翻訳機能を試してみたのでそれについて次に紹介します。

◾️GensparkのMoA v2の基本エージェント機能を使ってみた

画像生成機能

基本エージェントから画像生成機能を使ってみました。基本エージェントメニューから「画像生成」をクリックします。

するとこの様な画面になるので、どんな画像を生成したかを日本語のプロンプトで入力できます。ここでは、以下のプロンプトを入れてみました。

こちらが描いてくれた画像です。

4つの画像の案を出してくれるのはいいですね。でもどれも微妙なので、一番近いものをクリックして、余計な文字を消してとか、指摘を3回度ほどしてできたのがこのブログのアイキャッチ画像です。

翻訳機能

翻訳の基本エージェントも使ってみました。Time Magazineの記事から興味あるものをピックアップして翻訳をしてもらうことに。

こちらの記事です。

こちらが先ほどの基本エージェントの画面で「翻訳」を選んだ時の画面です。

ChatGPT-4oがデフォルトになっています。記事のURLを最初入れてみましたが、うまくいかず、英文をコピーして聞いてみました。その際にGPT-4oのプルダウンをクリックすると、ClaudeやDeepLなど複数の選択肢から選べる様になっています。

まずはMixture-of-Agentsを選んで、記事をコピペして翻訳してみました。

Mixture-of-Agentsを選んで結局うまくいかなかったので、Claude3.5 Sonnetを選んだ結果がこちらです。

いい感じで翻訳されています。記事が長いので、ポイントをまとめてもらいました。

わかりやすくまとまっています。この翻訳機能も使えそうです。

◾️まとめ

この記事では、GenSpark社が開発した最新AIモデル「MoA V2」(Mixture of Agents Version 2)について詳しく解説しました。

従来の単一モデルとは異なり、複数の専門エージェントが連携してタスクを処理する新たなアーキテクチャを採用しており、より高い柔軟性とパフォーマンスを実現しています。

特に、Gemini 2.0の搭載により、自然言語処理や高度な推論能力が大幅に向上。記事では、モデルの特徴、具体的な応用例として画像生成と翻訳機能を紹介しました。

紹介した機能は無料で使えるので、ぜひお試しください。